Der konkrete Anlass

Vor kurzem erreichte mich eine Beobachtung, die viele Content-Ersteller im wirtschaftspolitischen Bereich kennen dürften: Ein sorgfältig recherchiertes Video über Geldpolitik mit Bezug auf den argentinischen Präsidenten Javier Milei scheint deutlich weniger Reichweite zu erhalten als vergleichbare Inhalte – selbst bei Abonnenten. Die Vermutung liegt nahe: Werden freiheitliche Perspektiven systematisch benachteiligt? Und wenn ja – auf welcher Rechtsgrundlage?

Die regulatorische Realität: Der Digital Services Act

Seit dem 17. Februar 2024 gilt in der gesamten EU der Digital Services Act (DSA) – eine Verordnung mit weitreichenden Konsequenzen für alle Online-Plattformen, die ihre Dienste in der EU anbieten. Das gilt unabhängig davon, wo das Unternehmen seinen Sitz hat.

Die finanziellen Druckmittel

Die Zahlen sind eindeutig: Bei Verstößen gegen den DSA können Bußgelder von bis zu 6% des weltweiten Jahresumsatzes verhängt werden. Für Meta bedeutet das potenzielle Strafen in Milliardenhöhe. Zusätzlich können Zwangsgelder von bis zu 5% des Tagesumsatzes festgesetzt werden, bis Verstöße behoben sind. Im Dezember 2024 verhängte die EU-Kommission bereits eine Strafe von 120 Millionen Euro gegen X (ehemals Twitter) wegen Transparenzmängeln.

Zum Vergleich: Die maximalen DSGVO-Strafen liegen bei 4% des Jahresumsatzes – der DSA geht also noch weiter. Für kleinere Anbieter können bereits Bußgelder von bis zu 300.000 Euro verhängt werden.

In Deutschland ist die Bundesnetzagentur als „Digital Services Coordinator“ (DSC) für die Überwachung zuständig. Für sehr große Plattformen (VLOPs) mit über 45 Millionen monatlichen Nutzern in der EU – darunter YouTube, Facebook, Instagram, TikTok und X – ist direkt die EU-Kommission zuständig.

Was Plattformen konkret tun müssen

Der DSA verpflichtet Plattformen zu einer Vielzahl von Maßnahmen:

Für alle Plattformen:

- Melde- und Beschwerdeverfahren für „illegale Inhalte“

- Transparenzberichte über Moderationsmaßnahmen

- Zentrale Kontaktstellen für Behörden

- Verbot manipulativer „Dark Patterns“

Für sehr große Plattformen (VLOPs) zusätzlich:

- Jährliche Risikobewertungen zu „systemischen Risiken“

- Maßnahmen zur Risikominderung

- Unabhängige Audits

- Datenzugang für zugelassene Forscher

- Transparenz über Algorithmen und Empfehlungssysteme

Das Problem der vagen Begriffe

Hier beginnt das eigentliche Problem: Was genau ist ein „systemisches Risiko“? Was sind „schädliche Inhalte“? Der DSA bleibt bewusst vage.

„Illegale Inhalte“ – aber welche?

Der DSA definiert selbst nicht, was illegale Inhalte sind. Stattdessen verweist er auf nationales Recht und EU-Recht. In Artikel 3 lit. h DSA heißt es nur: „alle Informationen, die […] nicht im Einklang mit dem Unionsrecht oder dem Recht eines Mitgliedstaats stehen.“

Klar illegal sind etwa:

- Hassrede und Volksverhetzung

- Material über sexuellen Kindesmissbrauch

- Terroristische Inhalte

- Schwere Beleidigungen

- Urheberrechtsverletzungen

Aber: Was ist mit wirtschaftspolitischer Kritik? Mit Skepsis gegenüber Zentralbankpolitik? Mit der Infragestellung staatlicher Maßnahmen?

Desinformation – ein dehnbarer Begriff

Besonders kritisch wird es beim Thema „Desinformation“. Hier ist die Rechtslage eindeutig: Desinformation ist in der EU nicht per se illegal. Unwahre Tatsachenbehauptungen sind zwar nicht von der Meinungsfreiheit geschützt, profitieren aber von der „Legalität der Lüge“ – sie sind nur dann verboten, wenn sie in die Rechte Dritter eingreifen (etwa Beleidigung, üble Nachrede).

Dennoch müssen sehr große Plattformen laut Artikel 34 DSA „systemische Risiken“ bewerten, die sich aus der Verbreitung von Desinformation ergeben können. Sie müssen dann Maßnahmen zur „Risikominderung“ ergreifen.

Das Problem: Wer definiert, was Desinformation ist? Ein Video, das Zweifel an der Wirksamkeit expansiver Geldpolitik äußert? Ein Beitrag, der die Schuldentragfähigkeit moderner Wohlfahrtsstaaten hinterfragt? Kritik an den wirtschaftspolitischen Ansichten der EU-Kommission?

Verhaltenskodizes als „Soft Law“

Die EU hat zusätzlich zwei freiwillige Verhaltenskodizes etabliert:

- Den Verhaltenskodex zur Bekämpfung illegaler Hassrede (seit 2016, aktualisiert 2025)

- Den Verhaltenskodex zur Bekämpfung von Desinformation (seit 2018, aktualisiert 2022)

Diese Kodizes sind zwar freiwillig, aber: Plattformen, die sie unterzeichnen, müssen sich daran halten – und ihre Einhaltung wird von unabhängigen Prüfern kontrolliert. Außerdem gelten die Kodizes als Maßstab dafür, ob Plattformen ihre DSA-Verpflichtungen zur Risikominderung erfüllen.

Bemerkenswert: X (Twitter) hat sich 2023 aus dem Desinformations-Kodex zurückgezogen. Die EU-Kommission hat daraufhin mehrere Verfahren gegen X eingeleitet.

Die strukturelle Anreizwirkung zur Selbstzensur

Auch ohne explizite Zensur-Befehle entsteht ein massiver Anreiz zur Übererfüllung (Over-Compliance):

- Finanzielle Existenzbedrohung: Bei einem Jahresumsatz von Meta von etwa 134 Milliarden Dollar (2023) würden 6% Strafe rund 8 Milliarden Dollar bedeuten. Solche Summen motivieren zu äußerster Vorsicht.

- Unklare Rechtslage: Was genau als „systemisches Risiko“ oder „Desinformation“ gilt, ist nicht präzise definiert. Im Zweifel moderieren Plattformen lieber zu viel als zu wenig.

- Beweislastumkehr in der Praxis: Plattformen müssen nachweisen, dass sie „angemessene Maßnahmen“ zur Risikominderung ergriffen haben. Was „angemessen“ ist, entscheidet im Konfliktfall die EU-Kommission.

- Algorithmische Risikovermeidung: Wenn Inhalte zu bestimmten Themen (Geldpolitik, Staatsfinanzen, Wirtschaftsliberalismus) potenziell als „kontrovers“ oder „polarisierend“ eingestuft werden, liegt es für die Plattformen nahe, deren Reichweite präventiv zu reduzieren.

Konkrete Fälle zeigen das Muster

Die bisherige Durchsetzung des DSA ist aufschlussreich:

Gegen X (Twitter):

- Verfahren wegen angeblicher Verbreitung von Desinformation nach dem 7. Oktober 2023

- 120 Millionen Euro Strafe wegen Transparenzmängeln bei Werbung (Dezember 2024)

- Forderung nach Zugang zu internen Dokumenten über Algorithmen

Gegen Meta (Facebook/Instagram):

- Vorwurf: Unzureichende Meldemechanismen für illegale Inhalte

- Vorwurf: Zu komplizierte Beschwerdeverfahren für Nutzer

- Vorwurf: Erschwerter Datenzugang für Forscher

Gegen TikTok:

- Verfahren wegen „süchtig machendem Design“

- Vorwurf: Unzureichender Jugendschutz

- Vorwurf: Intransparenz bei Werbung

Auffällig: Die Verfahren konzentrieren sich auf Transparenz, Verfahren und „Risiken“ – nicht auf konkrete illegale Inhalte. Die Botschaft: Nicht nur was moderiert wird, ist relevant, sondern wie die Plattformen ihre Systeme gestalten.

Die internationale Dimension

Als die EU im Dezember 2024 gegen X eine Strafe verhängte, reagierte die US-Regierung scharf: Sie sprach von „Zensur“ und verhängte Einreiseverbote gegen einen der Architekten der EU-Digitalgesetze sowie andere Europäer.

Diese Reaktion zeigt: Der DSA wird zunehmend zu einem geopolitischen Instrument. Die Frage ist nicht nur, ob bestimmte Inhalte legal oder illegal sind, sondern wer die Macht hat, die Regeln für die digitale Öffentlichkeit zu definieren.

Die Fragen, die gestellt werden müssen

Zur Transparenz der Begriffe: Warum gibt es keine präzise Definition dessen, was als „systemisches Risiko“ im wirtschaftspolitischen Diskurs gilt? Ist Kritik an MMT (Modern Monetary Theory) Desinformation? Sind Bedenken bezüglich der Schuldentragfähigkeit „schädlich“?

Zur Verhältnismäßigkeit: Wenn ein seriöses, faktenbasiertes Video über Geldpolitik weniger Reichweite erhält – welche konkreten „Risiken“ rechtfertigen das? Wer hat diese Risikobewertung vorgenommen? Nach welchen Kriterien?

Zur demokratischen Legitimität: Sollten nicht gewählte Compliance-Beauftragte bei Plattformen – unter Androhung existenzbedrohender Strafen – darüber entscheiden, welche wirtschaftspolitischen Positionen eine breite Öffentlichkeit erreichen?

Zur Asymmetrie: Gibt es empirische Daten darüber, ob staatsnahe, interventionistische oder EU-freundliche Perspektiven systematisch bevorzugt werden? Die Beweislast liegt bei den Plattformen – aber sie veröffentlichen keine vergleichenden Daten.

Zu den Definitionsmacht: Wer entscheidet, was „Desinformation“ ist? Wenn eine Position von Mainstream-Ökonomen vertreten wird, aber libertäre Ökonomen widersprechen – wer hat recht? Und wichtiger: Wer darf das entscheiden?

Das grundsätzliche Problem

Selbst wenn es keine bewusste politische Diskriminierung gibt, bleibt ein strukturelles Problem:

- Algorithmen werden von Menschen programmiert und trainiert, die in bestimmten politischen und akademischen Milieus sozialisiert wurden.

- Wenn „Mainstream“ und „Qualität“ zu technischen Kategorien werden, bekommt das politische Konsequenzen.

- Wenn interventionistische Positionen als „seriös“ gelten, während marktliberale Ansätze als „kontrovers“ eingestuft werden, verschiebt sich der Diskursraum – auch ohne explizite Zensur.

- Die hohen Bußgelder schaffen einen massiven Anreiz, im Zweifel lieber zu viel als zu wenig zu moderieren.

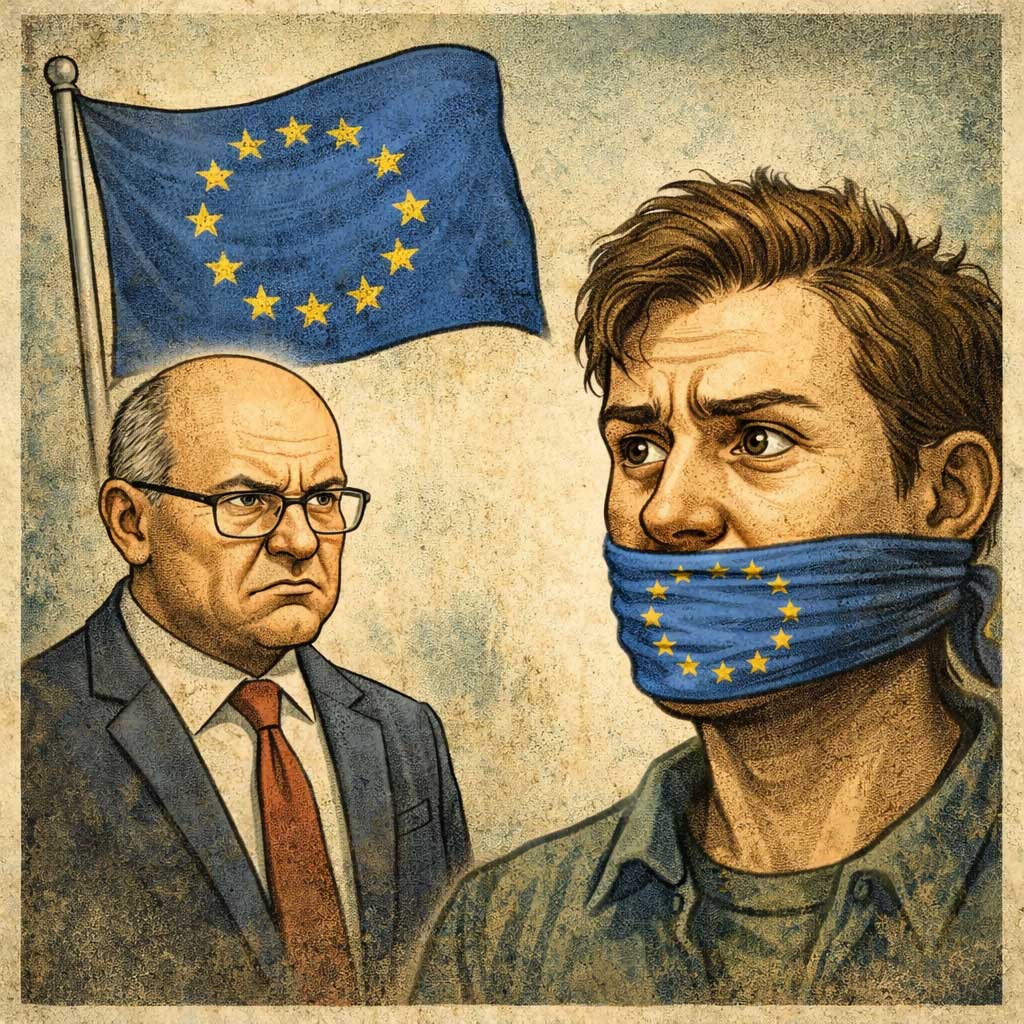

Eine Form indirekter Zensur?

Direkte Zensur – also das explizite Verbot, Staat oder EU zu kritisieren – gibt es im DSA nicht. Das wäre mit Artikel 11 der EU-Grundrechtecharta (Meinungs- und Informationsfreiheit) unvereinbar.

Aber: Wenn Plattformen unter Androhung von Milliardenstrafen verpflichtet werden:

- „Systemische Risiken“ zu bewerten (ohne klare Definition)

- „Desinformation“ zu bekämpfen (ohne Rechtsgrundlage für deren Verbot)

- „Angemessene Maßnahmen“ zu ergreifen (ohne Klarheit über das „Angemessene“)

- Ihre Algorithmen so zu gestalten, dass sie Risiken „mindern“

…dann entsteht eine indirekte Lenkungswirkung, die in ihrer Wirkung einer Zensur nahekommen kann – ohne formal eine zu sein.

Der Rechtswissenschaftler würde von „mittelbarer Grundrechtsbeeinträchtigung“ sprechen. Der Ökonom von „regulatorischer Übererfüllung“. Der Libertäre nennt es beim Namen: Zensur durch die Hintertür.

Was zu tun wäre

- Präzise Definitionen: Der DSA-Rahmen braucht klare, justiziable Definitionen dessen, was als „systemisches Risiko“ im Bereich politischer und wirtschaftspolitischer Diskurse gilt.

- Transparenzberichte: Plattformen sollten verpflichtet werden, aufzuschlüsseln, wie verschiedene politische Perspektiven in ihren Systemen abschneiden – mit vergleichbaren Metriken.

- Unabhängige Audits: Die Algorithmen und Moderationsentscheidungen sollten von unabhängigen Instanzen überprüft werden können – nicht nur auf Compliance mit dem DSA, sondern auf systematische Verzerrungen.

- Rechtsweg: Es muss einfache Rechtswege geben, um gegen Reichweiteneinschränkungen vorzugehen, wenn diese nicht auf klar illegalem Inhalt basieren.

- Grundrechtsschutz: Eine stärkere Gewichtung von Artikel 11 GRC (Meinungsfreiheit) gegenüber vagen Risikominimierungspflichten.

Fazit: Die Bürde des Beweises

Wir müssen nicht beweisen, dass es systematische Diskriminierung gibt. Die Plattformen müssen beweisen, dass es sie nicht gibt.

Sie verfügen über alle Daten. Sie kennen ihre Algorithmen. Sie wissen, nach welchen Kriterien Inhalte bewertet, empfohlen oder eingeschränkt werden. Wenn sie behaupten, es gebe keine Verzerrung zugunsten staatsnaher Positionen – sollen sie es beweisen.

Solange sie das nicht tun, bleibt der begründete Verdacht: Der Digital Services Act schafft – bei allen legitimen Zielen – einen regulatorischen Rahmen, der staatskritische, freiheitliche und wirtschaftsliberale Perspektiven strukturell benachteiligt. Nicht durch explizites Verbot, sondern durch Anreizstrukturen, vage Begriffe und die Androhung existenzbedrohender Strafen.

Das ist vielleicht keine Zensur im formalen Sinne. In der Wirkung kommt es ihr aber gefährlich nahe.

Quellen:

- Digital Services Act (Verordnung (EU) 2022/2065)

- EU-Kommission: DSA Enforcement Framework

- Bundesnetzagentur: Informationen zum DSA

- Heinrich-Böll-Stiftung: „Desinformation: Wie der Digital Services Act Plattformen verpflichtet – und wo es noch hakt“

- Verschiedene Berichte zu laufenden DSA-Verfahren gegen X, Meta und TikTok

Disclaimer: Dieser erweiterte Artikel basiert auf öffentlich zugänglichen Rechtstexten und Dokumentationen der EU-Kommission. Er erhebt keinen Anspruch auf den Beweis systematischer Diskriminierung, sondern analysiert die Anreizstrukturen und Interpretationsspielräume, die der DSA schafft. Alle rechtlichen Einschätzungen sind persönliche Meinungsäußerungen im Rahmen der durch Artikel 11 GRC geschützten Meinungsfreiheit.